Tu contrato enterprise con Claude acaba de convertirse en un pozo sin fondo: los tokens ahora se cobran por separado, y si tienes agentes autónomos en producción, tu factura podría multiplicarse sin que lo veas venir.

El cambio es estructural, no cosmético: el modelo Anthropic pricing enterprise pasó de un flat-rate por asiento —heredado del SaaS tradicional— a un modelo híbrido donde el consumo de tokens se factura por separado sobre el seat fee base. Lo que antes parecía predecible ahora tiene tail risk potencialmente ilimitado. Y la mayoría de los equipos de finanzas todavía no lo sabe.

Qué pasó

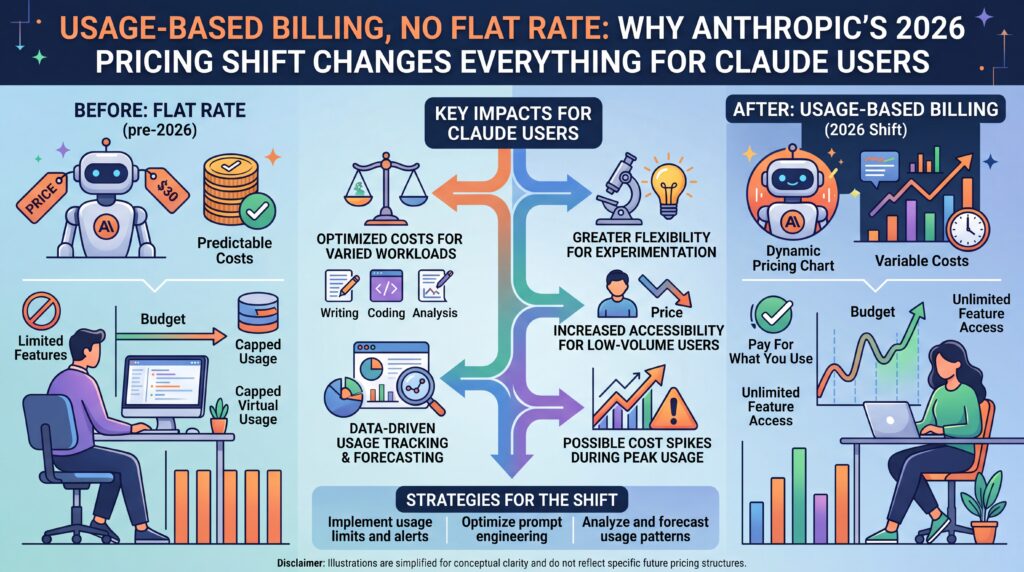

Hasta 2025, Claude Enterprise funcionaba con el modelo que todos conocen: pagas por asientos, tienes un cap implícito de uso, y la factura es más o menos estable mes a mes. Eso se acabó. Según reportes de HR Executive y Kingy AI, Anthropic reestructuró su pricing durante 2026: el consumo de tokens ahora se cobra encima del fee base por asiento, no incluido en él.

Los números de referencia en la API pública dan contexto al tamaño del problema: Claude Opus 4 cotiza ~$15/MTok de input y ~$75/MTok de output. Claude Sonnet 4.5 va a ~$3 y ~$15 respectivamente. Claude Haiku 4.5 es lo más económico con ~$0.80/$4 por millón de tokens. Para un chat humano normal, esas cifras son manejables. Para un flujo agentic que corre 24/7, son otra historia.

El contexto financiero detrás del movimiento es claro: Amazon lleva $13 mil millones invertidos en Anthropic, con hasta $20 mil millones más atados a milestones comerciales, y un compromiso de que Anthropic gaste más de $100 mil millones en AWS en 10 años. Anthropic también acaba de firmar un acuerdo con xAI para acceder al supercomputador Colossus 1 en Memphis —más de 220,000 GPUs, ~300 MW de capacidad. Están escalando infraestructura agresivamente. Alguien tiene que pagar eso.

Qué significa

El problema real no es que uses Claude para que tu equipo escriba correos. El problema es la multiplicación agentic. En flujos agente-a-agente, cada paso intermedio genera tokens adicionales: context windows completos, tool calls, respuestas intermedias, memoria de contexto. Un proceso agentic simple puede consumir 5-10x más tokens que un chat directo equivalente. No es exageración, es arquitectura.

Hay un riesgo que la mayoría ignora: el token multiplier de plataformas intermediarias. Si tu ATS, tu HRIS o tu CRM usa Claude como backend, ese vendor suma tokens de sistema, historial de conversación y tool calls encima de tu prompt real. El consumo facturable puede ser 3-8x el contenido semántico que realmente necesitas. Y si el vendor absorbía ese costo dentro de su flat fee, puede trasladarte el delta en la próxima renovación sin notificación explícita.

¿Es completamente malo el modelo? No. Kingy AI tiene razón en que para organizaciones con bajo consumo, el usage-based puede resultar más barato que pagar asientos infrautilizados. El riesgo es asimétrico: si usas poco, posiblemente ahorras; si escalas agentes autónomos, la factura puede duplicarse o triplicarse según analistas citados por Shopifreaks.

El timing tampoco es inocente. Esto ocurre exactamente cuando OpenAI lanzó su Deployment Company y CNBC reporta que el enterprise AI adoption está en un tipping point. Los tres grandes —OpenAI, Anthropic, Google— están en guerra por capturar facturación de tokens enterprise. El modelo flat-rate fue la zanahoria para entrar. El usage-based es la estructura que captura valor cuando ya dependes de ellos.

Qué hacer al respecto

- Audita todos tus contratos de vendors ahora, no en la próxima renovación. Cualquier plataforma HR, ERP o CRM que use Claude como backend puede estar absorbiendo costos de tokens que no van a absorber para siempre. Pregunta explícitamente: ¿el costo de tokens está incluido en tu flat fee o se puede trasladar? Si no tienes la respuesta por escrito, asume que te lo van a cobrar.

- Instrumenta métricas de consumo de tokens por flujo antes de escalar agentes a producción. Sin visibilidad granular, un solo proceso agentic que entre en loop o falle silenciosamente puede generar costos de miles de dólares en horas. No es hipérbole: es el tail risk del modelo. Implementa alertas de gasto por flujo con umbrales duros.

- Negocia caps de gasto mensual en tokens como cláusula contractual explícita. Bajo flat-rate no era necesario. Ahora es crítico. Tanto con Anthropic directo como con cualquier vendor intermediario: sin un spending cap escrito, estás expuesto a sorpresas que tu CFO no va a disfrutar.

- Usa arquitecturas híbridas de modelos. Haiku 4.5 a ~$0.80/MTok para clasificación, routing y tareas simples. Sonnet 4.5 para razonamiento intermedio. Opus 4 solo donde el razonamiento complejo justifica $15/MTok. Combinado con prompt caching —que da ~90% de descuento en tokens cacheados en la API de Anthropic— puedes recortar la factura entre 40-70% en flujos repetitivos sin sacrificar calidad donde importa.

- Optimiza context windows antes de escalar. El prompt engineering ya no es solo una práctica de calidad, es una iniciativa de reducción de costos con ROI directo. Cada token que eliminas de un system prompt que se ejecuta mil veces al día es plata real.

Si ya tienes Claude en producción con flujos agentes activos, esta semana corre los números con los precios actuales de la API como proxy. No esperes la factura de junio para descubrir qué tan expuesto estás.

¿Ya te llegó una renovación de contrato rara de algún vendor que usa Claude? Cuéntame en los comentarios cómo está quedando el desglose real en tu organización.

Preguntas frecuentes

¿El cambio en Anthropic pricing enterprise aplica a todos los contratos o solo a los nuevos?

Los reportes disponibles indican que el modelo híbrido es el estándar para nuevos contratos enterprise desde 2026. Los contratos vigentes bajo flat-rate previo pueden conservar sus términos hasta renovación, pero ese momento es exactamente cuando el cambio se materializa. Revisa tu fecha de renovación y actúa antes de llegar a ella sin preparación.

¿Cuánto puede costar realmente un agente autónomo corriendo con Claude Opus 4?

Depende de la arquitectura, pero para dimensionar: un flujo agentic que procesa 1,000 tareas al día con contextos de 10,000 tokens de input y 2,000 de output en Opus 4 puede generar ~$165 diarios solo en tokens, ~$5,000 al mes. Si ese mismo flujo entra en loop o escala sin control, el número crece proporcional. Por eso los spending caps son obligatorios, no opcionales.

¿El prompt caching de Anthropic aplica automáticamente o hay que configurarlo?

Hay que configurarlo explícitamente en la API usando el parámetro de cache_control en los bloques de contenido del system prompt. No es automático. Y vale la pena: Anthropic ofrece ~90% de descuento en tokens cacheados, lo que en flujos repetitivos con system prompts largos puede reducir la factura de manera significativa.

¿Tiene sentido migrar a otro proveedor para evitar este modelo de pricing?

La migración no resuelve el problema estructural: OpenAI y Google también operan bajo usage-based billing en sus tiers enterprise. El modelo de industria se está alineando en esa dirección. Lo que sí tiene sentido es no depender de un solo proveedor, tener fallbacks funcionales a modelos open-source hosteados (Llama, Mistral) para cargas de trabajo que no requieren frontier models, y negociar compromisos de volumen a cambio de precios fijos por tramos.

Fuentes

- The AI bill is coming due, and CHROs need to be ready – HR Executive (mayo 2026)

- Usage-Based Billing, No Flat Rate: Why Anthropic’s 2026 Pricing Shift Changes Everything – Kingy AI (abril 2026)

- Claude Platform On AWS Rewrites The Hyperscaler AI Bargain – Forbes (mayo 2026)

- OpenAI revenue chief says enterprise AI adoption is ‘at a tipping point’ – CNBC (mayo 2026)

- xAI leases Colossus 1 supercomputer to Anthropic – Let’s Data Science (mayo 2026)

- Anthropic shifts Claude Enterprise to usage-based billing – Shopifreaks (abril 2026)

- Claude API Pricing Guide 2026: Complete Cost Breakdown Per Million Tokens – AI Free API